随着大数据和人工智能时代的到来,网络数据抓取(爬虫)已成为一项重要的技术能力。Python凭借其简洁的语法、丰富的库和强大的社区支持,成为了爬虫开发的首选语言。对于希望入门Python爬虫开发的开发者而言,掌握以下几个核心技能至关重要。

一、扎实的Python编程基础

这是所有后续技能的基石。你需要熟练掌握:

- 基础语法与数据结构:变量、数据类型、条件判断、循环、列表、字典、元组、集合等。

- 函数与模块:理解如何定义和调用函数,以及如何导入和使用第三方模块。

- 面向对象编程(OOP):理解类与对象的概念,这在构建复杂爬虫项目时非常有用。

- 文件操作与异常处理:能够读写文件,并妥善处理程序运行中可能出现的错误。

二、核心网络请求库:Requests

Requests库是Python中进行HTTP请求的利器,它比Python内置的urllib库更简洁、易用。入门者必须学会:

- 发送GET和POST请求。

- 设置请求头(Headers),特别是

User-Agent,以模拟浏览器行为。 - 处理Cookies和会话(Session)。

- 解析服务器返回的响应状态码和内容。

三、强大的数据解析工具

从网页中获取的通常是HTML或XML格式的文本,需要从中提取结构化数据。主要掌握两种解析方式:

- BeautifulSoup:非常适合初学者,语法简单直观,能够以类似操作DOM的方式解析HTML/XML文档,提取标签、属性、文本等内容。

- lxml与XPath:性能优于BeautifulSoup,XPath是一种在XML文档中查找信息的语言,定位元素非常精准高效。对于复杂或大型页面的解析,lxml是更专业的选择。

四、动态网页处理:Selenium

许多现代网站使用JavaScript动态加载内容,单纯用Requests无法获取。此时需要Selenium这样的自动化测试工具。你需要学会:

- 控制浏览器(如Chrome、Firefox)进行页面加载、点击、输入等操作。

- 等待页面元素加载(显式等待和隐式等待)。

- 获取经过JavaScript渲染后的完整页面源代码。

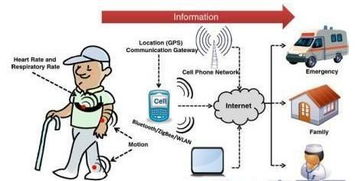

五、数据存储

爬取到的数据需要持久化保存,常用方式有:

- 文件存储:如保存为TXT、CSV、JSON文件。

csv和json模块是标准库的一部分,易于使用。 - 数据库存储:如SQLite(轻量级,Python内置支持)、MySQL、MongoDB等。了解基本的SQL语句或NoSQL操作是必要的。

六、反爬虫策略的初步应对

网站为保护数据和服务器,会设置反爬机制。入门者至少应了解并能够应对基础的策略:

- 设置合理的请求头,尤其是

User-Agent。 - 使用IP代理池(初步了解概念即可,入门阶段可暂缓深入)应对IP封锁。

- 添加请求延迟(如

time.sleep),避免过于频繁的请求对目标网站造成压力,这既是技术需要也是道德要求。

七、爬虫框架Scrapy(进阶)

当需要构建大型、健壮、可维护的爬虫项目时,Scrapy框架是工业级标准。作为入门,可以先了解其核心概念:

- 项目结构(Spiders, Items, Pipelines, Settings)。

- 爬取流程(Request/Response处理链路)。

它能够高效处理请求调度、数据提取和存储,内置了许多应对反爬的功能。

八、网络基础知识与法律法规意识

- 网络基础:理解HTTP/HTTPS协议、URL结构、状态码(如200成功、404未找到、403禁止访问)等基本概念。

- 法律法规与道德:这是最重要的一点。务必遵守网站的

robots.txt协议,尊重网站所有者的权益;不爬取个人隐私和敏感数据;控制爬取频率,避免对目标服务器造成过大负担。在开始任何爬虫项目前,请务必确认其合法性。

****:Python爬虫开发入门是一个循序渐进的过程。从Python基础和Requests库开始,逐步掌握数据解析、动态页面处理和基础的数据存储。在整个学习过程中,请始终将合法合规与道德约束放在首位。掌握了以上技能,你便已迈入了Python爬虫开发的大门,可以开始探索网络数据的广阔世界了。